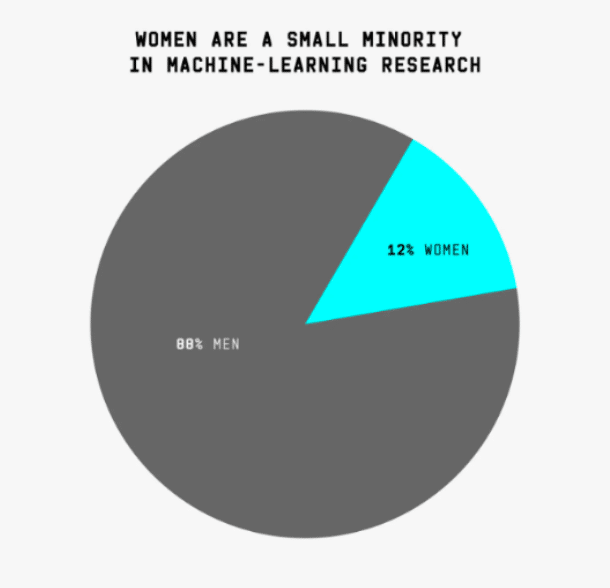

12%: ¿Qué representa este porcentaje? Es la tasa de representación de las mujeres en el campo de la Inteligencia Artificial en Francia. Sin embargo, la paridad es un objetivo que debe alcanzarse si queremos mitigar algunos de los peligros de la inteligencia artificial en Europa.

Todavía estamos muy lejos del 40% de estudiantes en el ámbito digital en 2020 mencionado por el señor Cedric Villani en su informe Ai for humanity en 2018.

Si la educación en igualdad y en digital es una condición previa y esencial, la paridad podría alcanzarse con una política de incentivos destinada a alcanzar un umbral del 40 % de estudiantes en las áreas digitales (clases preparatorias y carreras en grandes escuelas y universidades) para 2020.

Hoy, 2 años después de esa declaración, las cosas han evolucionado poco; el sector digital todavía tiene dificultades para atraer perfiles femeninos. La subrepresentación de las mujeres en los empleos de tecnología es un problema recurrente desde hace unos años.

Sin embargo, en los años 70 había un 30% de mujeres en el sector de la informática. En los años 80, el 40 % de los títulos en informática se otorgaban a mujeres en Europa y en Estados Unidos. Hoy en día, apenas alcanza el 20 %. En Francia, el 50% de los graduados de un bachillerato en ciencias son jóvenes chicas, pero es después de la orientación post-bachillerato donde las cifras comienzan a caer.

Varios factores que frenan esta paridad en inteligencia artificial

Según un estudio realizado por OPIIEC en 2016 entre alumnas de secundaria, estudiantes y empleadas, algunos factores influyen cuando se toma una decisión de orientación. Según un estudio reciente del BCG, varios factores influyen en las elecciones de orientación de las mujeres:

- la influencia de los medios que no comunican lo suficiente sobre todas las oportunidades del sector

- las aplicaciones de Inteligencia Artificial y sus impactos en la sociedad que siguen siendo abstractos (ya que las mujeres tienen en cuenta más que los hombres la necesidad de concreción en su trabajo)

- el desconocimiento de las profesiones en el campo de la tecnología

- la falta de modelos femeninos a seguir

- una vida empresarial a veces vista como difícil (la competencia percibida como superior en este ámbito con el ejemplo de las numerosas competiciones en ciencia de datos)

Tantos clichés que es urgente desmontar para atraer a las mujeres al mundo digital.

Ya se han implementado estrategias para promover el lugar de las mujeres y niñas en la Inteligencia Artificial, o aún están por desarrollarse en diferentes niveles (autoridades públicas, asociaciones, empresas, educación…). De hecho, una gran coalición se ha creado bajo los auspicios de la Secretaría de Estado para lo Digital. Esta iniciativa fue iniciada por 6 asociaciones fuertemente comprometidas con la inclusión de las mujeres en los empleos digitales.

La diversidad de equipos, una condición esencial para una IA responsable

Nuestra sociedad ya está profundamente transformada por la Inteligencia Artificial (Aprendizaje automático, Aprendizaje profundo, etc.) y está destinada a encontrar aplicaciones en un número creciente de sectores, desde la industria hasta la salud, pasando por las finanzas. Sin embargo, actualmente una gran parte de estos sistemas de Inteligencia Artificial con un fuerte impacto social, son desarrollados por el mismo tipo de perfil, hombres…

Entonces surge una pregunta...

¿Cómo construir la sociedad digital del mañana, ética y equitativa, si es construida por el mismo tipo de persona?

Involucrar más a las mujeres en la Inteligencia Artificial no significa solo responder a expectativas éticas o complacer a las feministas, es una verdadera cuestión societaria. Las cifras mencionadas anteriormente muestran que la representación de las mujeres en los campos de la Inteligencia Artificial sigue siendo muy baja. Rosabeth Kanter [profesora de Harvard Business School] demostró que a partir de un cierto umbral de diversidad dentro de un equipo, se producen nuevos puntos de vista y cambios de comportamiento. Esto es aplicable en todas las disciplinas. Sin embargo, la falta de mujeres en el diseño de algoritmos aumenta el riesgo de sesgo.

Un ejemplo de sesgo concreto, en 2018, Joy Buolamwini, una estudiante negra en el MIT, se interesó en los softwares de reconocimiento facial porque había notado que algunos no funcionaban con ella. En sus diversos trabajos, demostró que los sistemas de reconocimiento facial tenían dificultades para detectar o identificar correctamente caras negras. Según ella y otros expertos, es porque en gran parte son diseñados por ingenieros blancos, que usan bibliotecas de software que a menudo también fueron escritas por ingenieros blancos. Como cualquier persona, estos tienen sesgos, que luego se reflejan en el código. Esta discriminación es un ejemplo del tipo de «sesgo algorítmico», incluso si los diseñadores del algoritmo eran neutrales y no tenían intención de inducir este sesgo, reflejó tendencias particulares o discriminaciones existentes (que pueden encontrarse en los conjuntos de datos en los que se entrena el algoritmo, por ejemplo).

Los ejemplos de sesgos racistas o sexistas se han multiplicado en los últimos años: una Inteligencia Artificial de Google que identificaba con la palabra «gorilas» a dos afroamericanos o más recientemente una herramienta de asistencia en la contratación utilizada por Amazon y que desfavorecía a las mujeres…

Un algoritmo, desde cierto punto de vista, puede considerarse como un niño, necesita ser educado. Sin embargo, cambiar unas pocas líneas de código no será suficiente para solucionar los problemas, no se puede codificar la igualdad a menos que los equipos sean mixtos.

Por tanto, se necesitan equipos de investigadores diversos para construir una Inteligencia Artificial imparcial, equitativa y sin prejuicios. Pero para ello, es imperativo alentar a las mujeres a adentrarse en el campo de la ciencia de datos y favorecer su desarrollo de habilidades. Si las mujeres no se adueñan de este campo, la Inteligencia Artificial desarrollada simplemente no será representativa de nuestras sociedades.

Incluso los gigantes de Internet están atrasados en la formación de equipos de científicos de datos, analistas de datos, ingenieros de datos donde se respeta la paridad de género. Sin embargo, es esencial para desarrollar una IA ética. Actualmente en Google, la proporción de mujeres representa solo el 32.5% de los empleados y en los puestos de investigadores en ciencia de datos esta representación cae alrededor del 15%. Todavía estamos lejos de una verdadera paridad, lo que también demuestra una necesidad real de reclutar perfiles femeninos en ciencia de datos.

Por lo tanto, Señoras y Señoritas, las oportunidades para ustedes en este sector son exponenciales, no deben perderse una oportunidad como esta.

Reconvertirse o reorientarse en el campo de la ciencia de datos no es tan complicado como parece, no es necesario tener un máster en matemáticas aplicadas.

En DataScientest abrimos nuestros cursos de Data Science a perfiles muy variados. Claro está, es necesario tener buenos conocimientos en términos de programación o matemáticas.

No duden en contactar con nuestros equipos o consultar nuestras páginas dedicadas para más información 😊

Nos complacerá responder a todas sus preguntas y estudiar juntos la realización de su proyecto profesional en Data Science.

La Inteligencia Artificial necesita cerebros de todos los ámbitos para poder convertirse en un verdadero reflejo de la sociedad.