Adversarial robustness: ¿Qué es? ¿Para qué sirve?

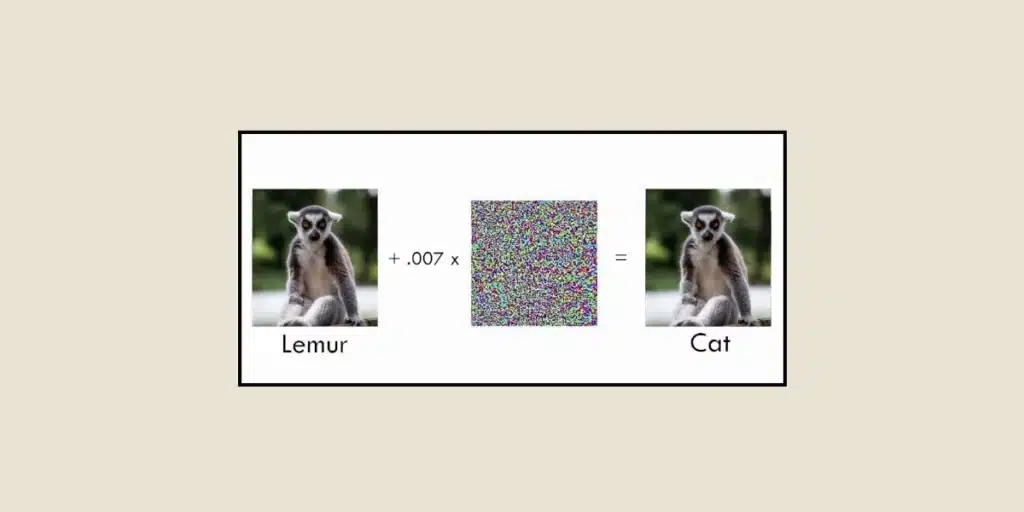

La adversarial robustness se centra en la seguridad de los modelos de machine learning haciéndolos resistentes a ataques maliciosos. Su objetivo es desarrollar mecanismos de defensa y técnicas de refuerzo de seguridad para garantizar que los modelos puedan mantener su rendimiento en presencia de ataques adversariales, asegurando así la fiabilidad y seguridad de los sistemas […]