Se habla a menudo de las posibles desviaciones de la Inteligencia Artificial, del riesgo de reemplazo de la inteligencia humana en una visión apocalíptica de la tecnología. Lejos de este diagnóstico alarmante, en DataScientest, tratamos de poner la IA al servicio de lo humano. Y los proyectos de nuestros aprendices son la mejor prueba. Hoy hemos decidido compartir con ustedes el trabajo notable realizado por dos de ellos: Malik y Lamia. Durante 11 semanas, trabajaron en un proyecto de gafas conectadas al servicio de las personas con problemas de audición, que les permitirían ver subtítulos mostrados debajo de las palabras de sus interlocutores.

Los entrevistamos para saber más sobre las diferentes etapas de su proyecto. Vuelta a su trayecto ejemplar y su trabajo siempre motivado por su preocupación por mejorar la vida de las personas con discapacidad.

Malik es Arquitecto de Soluciones y Lamia es Ingeniera en Sistemas de Información. Durante su bootcamp de Data Scientist en DataScientest en julio de 2020, estos dos apasionados por la IA decidieron embarcarse en un proyecto común.

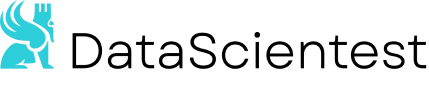

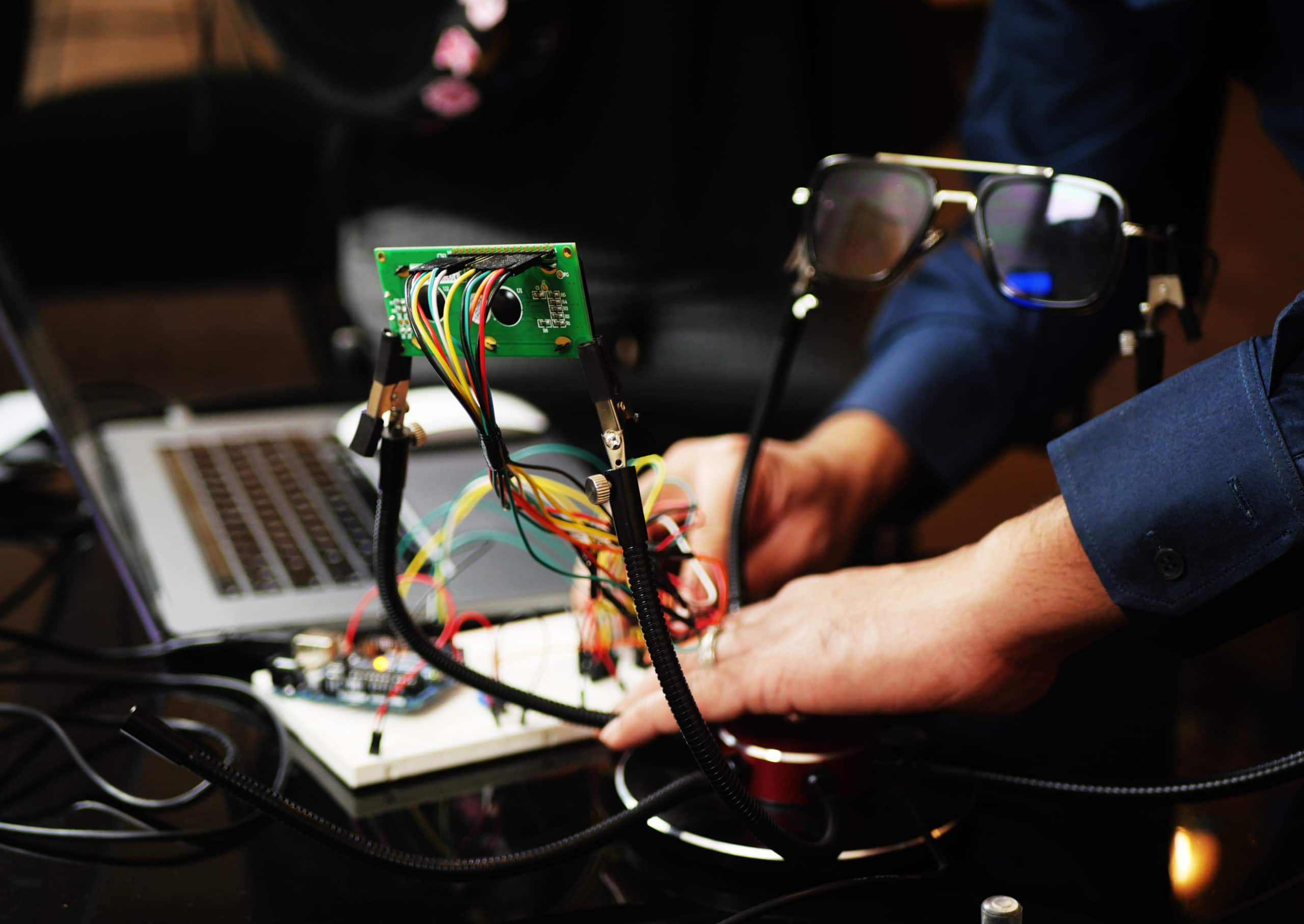

La idea: localizar y transcribir la voz de un interlocutor en gafas conectadas. Su objetivo: ofrecer a una persona con problemas de audición una alternativa para superar su discapacidad. Nació el proyecto Voice Glass.

Rápidamente, el equipo estableció tres objetivos a lograr:

- Realizar modelizaciones a partir de un conjunto de datos lo suficientemente amplio para hacer la predicción en texto de una voz procedente de un archivo de audio.

- Construir una aplicación de tipo «WebApp» para realizar una demostración ante el jurado de DataScientest.

- Crear un prototipo de gafas conectadas.

Esta última etapa, considerada como opcional en el marco del proyecto y dada la cantidad de horas inicialmente previstas, fue vista desde el principio por Malik y Lamia como indispensable para la concretización de su trabajo.

Primer paso: realizar un análisis exploratorio de los datos y producir DataViz para entender mejor los conjuntos de datos disponibles.

Luego, el dúo trabajó en el módulo de reconocimiento de voz presente en la plataforma DataScientest para asimilar los fundamentos de esta tecnología e inspirarse de los conceptos enseñados para el resto del proyecto.

A continuación, la fase de preparación de los conjuntos de datos antes de pasar a la modelización.

Una vez más, es la visión global del proyecto la que permite a Malik y Lamia sacar el máximo provecho de su trabajo en equipo. Lamia trabaja en la predicción de palabras simples (Single Words) mientras que Malik se enfoca en las palabras múltiples (Multiple Words) (frases donde la problemática compleja del alineamiento de los sonidos con las palabras se debe tener en cuenta).

Para las Single Words, el modelo elegido es una red de convoluciones 1D, justificada ya que la predicción se realiza finalmente sobre una clase de palabras.

Para las Multiple Words, se necesita otra estrategia, como utilizar las redes neuronales recurrentes RNN, ampliamente usadas en la industria del Deep Learning para el reconocimiento de voz. Sin embargo, entrenar redes RNN requiere de un equipo informático de alto rendimiento del que el equipo no dispone.

Como alternativa, eligen una red de convoluciones dilatadas con el modelo SpeechNet – variante del famoso modelo WaveNet utilizado por Google.

También presentan la dificultad de comprender los conceptos avanzados de reconocimiento de voz. Se necesitó asimilar muchos conceptos en un tiempo récord.

Misión cumplida por este dúo dinámico cuya ambición es igual a su determinación de usar su conocimiento en ciencia de datos al servicio del mayor número posible.

Malik y Lamia así profundizaron sus conocimientos en análisis de datos, aprendizaje profundo y reconocimiento de voz a lo largo del proyecto.

Después de más de 120 horas de trabajo, y con el apoyo de su mentor Thomas, el dúo alcanzó estos tres objetivos y pueden presentarnos orgullosamente su prototipo funcional.

He aquí la demo:

¿Una continuación para su proyecto? Como en la elaboración de este, Malik y Lamia tienen grandes aspiraciones y les encantaría encontrar un eco suficiente para convertirlo en un producto terminado disponible en el mercado para personas con problemas de audición.

Idealmente, les gustaría mejorar su prototipo de gafas conectadas con la ayuda de otros perfiles técnicos como un Data Scientist especializado en NLP pero también un Data Engineer. La ambición, por supuesto, es ver el proyecto acelerarse dentro de un incubador de startups.

Gracias a Malik y Lamia por sus testimonios y si deseas contactarlos para continuar el proyecto, sus perfiles de Linkedin están accesibles en la demo.