L’apprentissage continu ouvre des nouvelles perspectives dans l’ère de l’intelligence artificielle en constante évolution. Cette approche permet aux modèles de s’adapter progressivement aux nouvelles données sans perdre les connaissances préalablement acquises. Flexibles et résilients, les systèmes d’apprentissage continu évoluent harmonieusement avec les changements du monde réel. Cet article explore les principes clés de l’apprentissage continu, ses applications ainsi que les défis et solutions face à l’avenir dynamique des données.

C’est quoi l’apprentissage continu ?

Continual Learning (CL) est une approche en Machine Learning qui peut se traduire comme « apprentissage continu » ou « apprentissage en continu ». Il est parfois aussi appelé Incremental Learning ou Lifelong Learning (apprentissage incrémental ou apprentissage tout au long de la vie, respectivement).

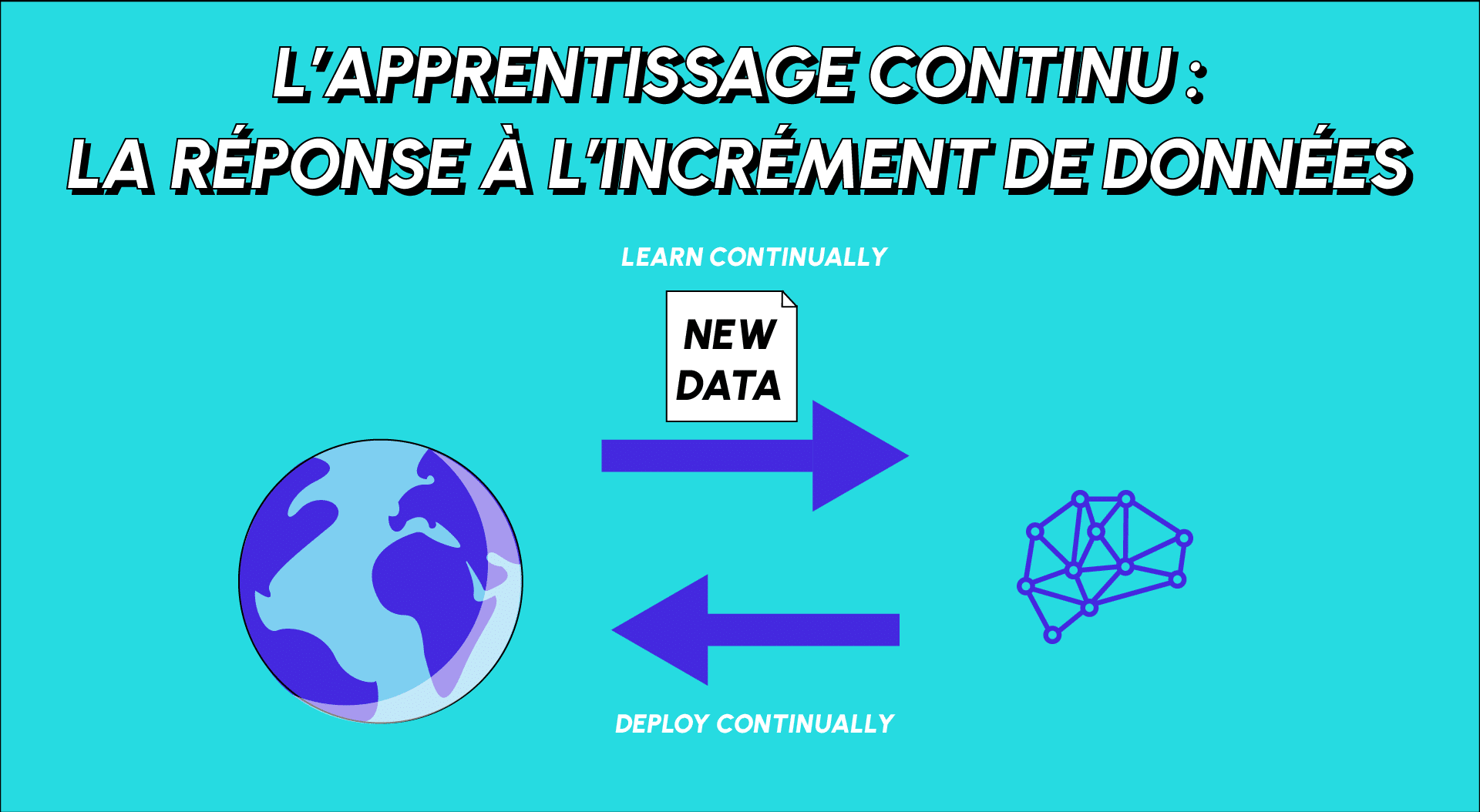

L’idée derrière le CL est d’imiter l’esprit humain où l’on continue à apprendre tout le long de nos vies et où les informations acquises précédemment servent de base pour les nouveaux apprentissages. Contrairement à l’apprentissage traditionnel, où les modèles sont formés sur un jeu de données fixe, l’apprentissage continu permet aux modèles de s’adapter et de se mettre à jour en continu à mesure que de nouvelles données deviennent disponibles, sans devoir tout recommencer à zéro.

L’objectif de l’apprentissage continu est de permettre aux modèles d’être plus flexibles, adaptables et résilients dans des scénarios où les données évoluent ou changent au fil du temps.

Parlons de tailles de données

C’est une évidence que les données ne font que continuer à augmenter, chaque jour on en a de plus en plus et les entreprises ont besoin de pouvoir s’en servir. Alors la question qui se pose naturellement est comment est-ce qu’on peut assurer que nos modèles de Machine Learning peuvent traiter de plus en plus de données tout en restant efficaces computationnellement ou au moins, durables ?

La réponse est qu’il faut être capable de traiter les données et ensuite pouvoir s’en débarrasser. Tout comme les systèmes biologiques le font : il serait impossible pour un humain de traiter et sauvegarder des milliers d’informations dans le long terme !

Il est donc important d’envisager les modèles de Machine Learning comme l’esprit humain, capable de filtrer l’information qu’il capte, de retenir ce qui est important et de construire à partir de cela.

Et même si la puissance de calcul ne fait qu’augmenter, d’après l’IDC (International Data Group) on est sur le point de dépasser la quantité d’information générée de la capacité d’information qu’on peut stocker. Arrivée à l’année 2025 le taux de génération de données atteindra les 160 ZO (zettaoctets) dont on sera en mesure de stocker entre 3% et 12% seulement. Cela veut dire que les données devront être traitées sur le coup, au risque de les perdre pour toujours.

C’est pour cela que l’apprentissage continu n’est pas seulement un moyen d’optimiser la charge computationnelle que les modèles peuvent représenter en évitant les réentraîner à chaque fois qu’on a des nouveaux données, mais qu’il s’agit aussi d’un moyen de pouvoir traiter des données avant de les perdre potentiellement.

Les objectifs principaux

Ayant défini l’apprentissage continu et ayant parlé des ses bénéfices, ses objectifs principaux sont les suivants :

- Flexibilité du modèle. En permettant aux modèles de s’adapter de manière continue aux nouvelles données, l’apprentissage continu rend les modèles plus souples et mieux adaptés à des situations dynamiques.

- Conservation des connaissances. L’apprentissage continu vise à éviter l’oubli catastrophique, un problème où les modèles oublient complètement des connaissances précédemment apprises lorsqu’ils sont mis à jour avec de nouvelles données.

- Économie de ressources. Plutôt que de former le modèle depuis le début avec l’ensemble complet des données chaque fois que des mises à jour surviennent, l’apprentissage continue d’économiser des ressources en n’effectuant que des ajustements incrémentiels.

Les défis de l’apprentissage continu

Même quand l’apprentissage continu semble être la réponse idéale pour affronter les possibles problèmes liés à la taille des données dans l’avenir, comme pour tout dans la vie, il existe aussi quelques défis qui doivent être pris en compte pour obtenir des résultats fiables et performants.

- Oubli catastrophique. Lorsque de nouvelles données sont présentées, les modèles doivent éviter d’oublier les connaissances antérieures. Des approches telles que l’utilisation de mémoires externes ou le réentraînement sur des données anciennes avec des poids réduits pour les nouvelles tâches peuvent aider à atténuer ce problème.

- Réglage fin (fine tuning). Pour adapter le modèle aux nouvelles données, un réglage fin des poids est généralement nécessaire. Cependant, cela peut être difficile lorsqu’il y a une hétérogénéité des données et des tâches. Des techniques de réglage fin adaptatif ou de méta -apprentissage peuvent être utilisées pour mieux gérer cette variabilité.

- Impraticabilité des mémoires. Dans certains cas, la quantité de données accumulées peut devenir trop importante pour être stockée en mémoire. L’utilisation de techniques de consolidation des connaissances ou d’échantillonnage intelligent peut permettre de gérer efficacement cette situation.

Quelques applications concrètes

L’apprentissage continu trouve des applications dans divers domaines où les données sont en constante évolution. Pour mentionner quelques-uns, on a notamment :

- Reconnaissance vocale et traitement du langage naturel (NLP). Le CL permet aux modèles de s’adapter à de nouvelles expressions, mots et concepts au fur et à mesure qu’ils deviennent courants.

- Vision par ordinateur. De nouvelles images et vidéos sont générées en permanence. L’apprentissage continu permet aux modèles de se mettre à jour pour reconnaître des nouveaux objets, de nouvelles scènes ou d’autres caractéristiques visuelles émergentes.

- Systèmes d’Apprentissage en ligne. Elles peuvent être mises à jour en fonction des interactions des utilisateurs, l’apprentissage continu est essentiel pour adapter les modèles d’apprentissage automatique en fonction des nouvelles informations sur les préférences et les comportements des utilisateurs.

Conclusion

L’apprentissage continu est une approche très prometteuse en Machine Learning pour améliorer l’adaptabilité des modèles aux changements continus des données ainsi qu’à leur accroissement. En permettant aux modèles de s’ajuster progressivement aux nouvelles informations, l’apprentissage continu ouvre la voie à des systèmes plus flexibles et mieux adaptés à des environnements dynamiques. Malgré les défis associés, les avances récentes dans ce domaine montrent que l’apprentissage continu est une direction prometteuse pour rendre les systèmes de Machine Learning plus agiles et plus performants dans un monde en constante évolution.