Unter den vielen verschiedenen Cyberangriffen, die es gibt und die Computersysteme angreifen, zeichnet sich Data Poisoning dadurch aus, dass die Trainingsdaten von Machine-Learning-Modellen verfälscht werden. Was bedeutet dies? Stellt dies eine echte Gefahr dar? Hier ist ein kurzer Überblick über diesen speziellen Angriff, die daraus resultierenden Bedrohungen und Möglichkeiten, sich dagegen zu wehren.

Was ist Data Poisoning ?

Data-Poisoning-Angriffe traten mit der massiven Einführung von Machine-Learning-Modellen Ende des 20. Jahrhunderts auf.

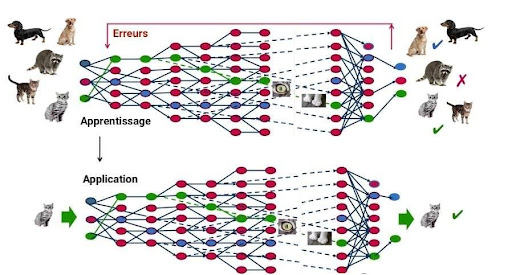

Diese Angriffe treten in der Trainingsphase von Machine-Learning-Modellen auf. Ein Machine-Learning-Modell muss mit echten Daten trainiert werden, damit es funktioniert. Nach und nach wird das Machine-Learning-Modell aus seinen Fehlern lernen und seine Aufgabe immer genauer ausführen.

Ein Prognosemodell ist ein Computerprogramm, das in der Lage ist, eine bestimmte Aufgabe zu erfüllen, z. B. Folgendes zu erkennen

Aber der Data Poisoning-Angriff, der auf die Trainingsphase einwirkt, wird die Ergebnisse des Vorhersagemodells verändern oder sogar komplett verfälschen. Das Beispiel der Angriffe, die sich zwischen 2017 und 2018 gegen Googles Anti-Spam-System richteten, zeigt deutlich, wie sie wirken. Googles Anti-Spam-Modell wird mit Daten trainiert, die man als Input/Tag-Paare bezeichnet.Der Input ist eine E-Mail oder eine Textnachricht und das Label gibt an, ob es sich bei der Nachricht um Spam handelt oder nicht.

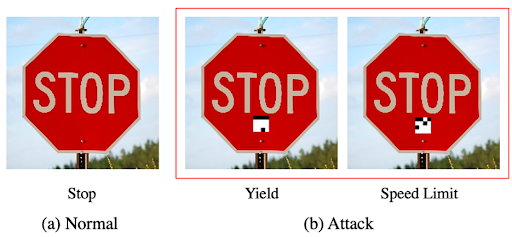

Hier kommt die Data Poisoning-Attacke ins Spiel. Er wird diese Trainingsdaten massiv korrumpieren und verfälschen, indem er z. B. angibt, dass eine Spam-Nachricht keine Spam-Nachricht ist. Dieser Angriff wird die Genauigkeit des Machine-Learning-Modells beeinträchtigen. Im Fall von Google reiben sich die Spammer dann die Hände: Sie können Spam versenden, ohne dass das Antispam-Modell von Google dies meldet. Data Poisoning-Angriffe können auch auf Modelle zur Erkennung von Verkehrsschildern einwirken, die z. B. für selbstfahrende Autos verwendet werden.

Wenn dieses Modell vergiftet wird, könnte es durchaus ein Stoppschild mit einem Geschwindigkeitsbegrenzungsschild verwechseln.

Dieser Angriff ist für den kleinsten Hacker sehr leicht zugänglich geworden. Früher waren Data Poisoning-Angriffe schwer durchführbar, weil sie eine hohe Rechenleistung, Zeit und Geld erforderten. Mit neuen Techniken können diese Hindernisse jedoch umgangen werden. Besonders problematisch ist die TrojanNet-Backdoor-Technik. Diese Technik benötigt durch die Erstellung eines neuronalen Netzes, das eine Reihe von Patches erkennt, keinen Zugriff auf das Originalmuster und kann von einem einfachen Computer durchgeführt werden.

Was sind die Data Poisoning Gefahren ?

Die Tatsache, dass ein Data Poisoning-Angriff sehr leicht zugänglich geworden ist, macht ihn zu einer echten Gefahr. Wenn die Trainingsphase des Modells einmal abgeschlossen ist, ist es sehr schwierig, das Machine-Learning-Modell zu korrigieren. Man müsste eine lange Analyse aller Inputs, die das Modell trainiert haben, durchführen, betrügerische Inputs aufspüren und sie entfernen. Wenn die Datenmenge jedoch zu groß ist, ist eine solche Analyse schlichtweg unmöglich. Die einzige Lösung ist dann, das Modell erneut zu trainieren.

Diese Trainingsphasen können jedoch extrem teuer sein: Im Fall des von Open AI entwickelten KI-Systems GPT-3 kostete die Trainingsphase rund 16 Millionen Euro….

Über die reinen wirtschaftlichen Kosten hinaus kann Data Poisoning eine noch größere Gefahr darstellen. Künstliche Intelligenz und Machine-Learning-Modelle nehmen in unserer Gesellschaft einen immer größeren Stellenwert ein und werden für Aufgaben von höchster Wichtigkeit eingesetzt, z. B. im Gesundheitswesen, im Transportwesen und bei der Ermittlung von Straftaten. Die Polizei von Chicago setzt KI zum Beispiel bei der Verbrechensbekämpfung ein, um vorherzusagen, wann und wo Gewaltverbrechen stattfinden werden.

Was passiert, wenn die Daten in ihren Modellen vergiftet werden?

Die Verbrechensbekämpfung wird ineffizient und die Modelle lenken die Polizei auf falsche Fährten.

Wie kann man sich vor Data Poisoning schützen ?

Glücklicherweise gibt es Mittel und Wege, um gegen Data Poisoning vorzugehen.

Eine erste Technik besteht darin, die Datenbanken zu überprüfen, bevor sie in die Trainingsdaten des Modells eingespeist werden. Dies kann durch statistische Methoden zur Erkennung von Anomalien in den Daten, durch Regressionstests oder auch durch manuelle Moderation geschehen.

Mithilfe von Cloud-Tools wie Azure Monitor oder Amazon SageMaker kann man auch feststellen, ob die Leistung des Modells während der Trainingsphase abnimmt, und sofort darauf reagieren.

Da Data Poisoning eine Vorkenntnis des Modells voraussetzt, müssen die Informationen über die Funktionsweise des Modells während der Trainingsphase geheim gehalten werden.

Data Poisoning stellt also eine echte IT-Bedrohung dar, und das umso mehr, als diese Angriffe für Hacker immer leichter zugänglich sind. Angesichts des technischen Fortschritts der Hacker liegt die Herausforderung jedoch in der Verbesserung der Präventionssysteme. Data Scientists und Data Engineers stehen bei der Bekämpfung dieser Angriffe an vorderster Front. Sie sind es, die sichere Daten sammeln oder Angriffe während der Trainingsphasen erkennen müssen. Wenn du mehr darüber erfahren möchtest, wie diese Modelle funktionieren und wie sie geschützt werden können, dann wirf einen Blick auf unsere Ausbildungsmöglichkeiten im Bereich der Datenverarbeitung oder zum Data Engineer