Bei der Gestaltung eines tiefen neuronalen Netzes können verschiedene Arten von Architekturen der ersten Ebene verwendet werden. Eine davon ist das dichte neuronale Netzwerk. Worum handelt es sich also? Wie funktioniert es? Finde die Antworten in diesem Artikel.

Was ist ein dense neural network?

Ein dichtes neuronales Netz ist ein Modell für maschinelles Lernen, bei dem jede Schicht tief mit der vorherigen Schicht verbunden ist.

Zur Erinnerung: Die Schichten bestehen aus Knoten. Die Knoten kombinieren die Eingaben eines Datensatzes mit einem gewichteten Koeffizienten, um den Wert zu erhöhen oder abzuschwächen. Dabei führen sie Berechnungen an den Daten durch.

In einem Stadion sind die Knoten die Sitze und die Schichten die Sitzreihen. Und alles zusammen bildet die Architektur des Modells (oder das Stadion als Ganzes). Innerhalb eines Modells ist jede Schicht aufgrund ihrer Eigenschaften und Funktionen von Bedeutung. Einige werden für die Zeitreihenanalyse verwendet, andere für die Bildverarbeitung und wieder andere für die Verarbeitung von natürlicher Sprache.

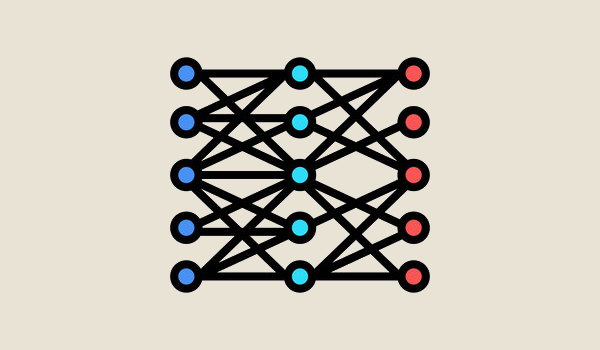

Um auf das dichte neuronale Netzwerk zurückzukommen: Die Neuronen einer Schicht sind mit allen Neuronen der vorherigen Schicht verbunden. Aufgrund dieser Ultraverbindung ist es das am häufigsten verwendete Modell für künstliche neuronale Netze.

Gut zu wissen: Auch wenn man von einem dichten neuronalen Netz spricht, werden die dichten Schichten (oder tief verbundenen Schichten) nicht unbedingt von Anfang bis Ende des Lernprozesses verwendet. Oft werden sie erst in den letzten Phasen des neuronalen Netzes eingesetzt. In diesem Fall werden andere Arten von Schichten verwendet.

Wie funktioniert das dense neural network?

In einem dichten neuronalen Netzwerk erhält die dichte Schicht einen Output vom Neuron der vorherigen Schicht. Die so übertragenen Eingabedaten werden in Form einer Matrix übermittelt.

Um die Verbindung zwischen allen Schichten zu erleichtern, wird die Matrix vektoriell multipliziert. Dadurch wird der Output verändert und der nächste Schritt eingeleitet.

Aber Vorsicht: Matrix-Vektor-Multiplikation bedeutet, dass der Zeilenvektor des Outputs gleich dem Spaltenvektor der dichten Schicht ist. Mit anderen Worten: Damit es funktioniert, müssen zwischen den beiden Vektoren genauso viele Spalten liegen. Es ist dieser ganze Prozess, der es dem Netzwerk ermöglicht, Verbindungen zwischen den Werten der verfügbaren Daten herzustellen.

Um dir zu helfen, die Funktionsweise des Dense Neural Network besser zu verstehen, sehen wir uns seine Implementierung mithilfe des Keras-Tools an.

Wie implementiert man ein dichtes neuronales Netz mit Keras?

Die Keras API

Um ein dichtes neuronales Netzwerk einzurichten, muss ein leistungsfähiges Werkzeug verwendet werden. Eines der am häufigsten verwendeten ist Keras.

Dabei handelt es sich um eine Python-API, die auf der Machine-Learning-Plattform Tensorflow läuft. Diese API ermöglicht es ihren Nutzern, mehrere vorkonstruierte Schichten in verschiedenen Architekturen neuronaler Netze hinzuzufügen. Mit seiner intuitiven Benutzeroberfläche und der schnellen Bereitstellung in der Produktion erleichtert Keras die gesamte Erfahrung mit TensorFlow.

Um ein Modell für maschinelles Lernen zu erstellen, müssen die verschiedenen Keras-Schichten gestapelt werden. Es ist möglich, eine einzige dichte Schicht zu verwenden, um ein lineares Regressionsmodell zu entwerfen. Oder mehrere dichte Schichten, um ein echtes dichtes neuronales Netzwerk zu erstellen.

Gut zu wissen: Die Keras-API enthält verschiedene Arten von Layern, wie z. B. Output-Layer, Activation-Layer, Integration-Layer und natürlich die Dense-Layer. Wir werden uns gerade die verschiedenen Parameter ansehen, die für letztere verwendet werden.

Die Hyperparameter von Keras

Um ein dichtes neuronales Netzwerk zu entwerfen, bietet Keras seinen Nutzern eine umfassende Syntax, die aus mehreren Hyperparametern und Attributen besteht. Hier sind die wichtigsten:

- Einheiten: Er definiert die Größe des Outputs der dichten Schicht. Sie ist immer eine positive ganze Zahl.

- Aktivierung: Mit ihr werden die Eingabewerte der Neuronen transformiert. Durch die Einführung einer Nichtlinearität sind neuronale Netze in der Lage, die Beziehung zwischen Input- und Outputwerten zu verstehen.

- Die Kerngewichtsmatrix: Sie ist das Herzstück des neuronalen Netzes. Diese Matrix wird verwendet, um die Eingabedaten zu multiplizieren und die Hauptmerkmale daraus zu extrahieren. Hier können mehrere Parameter eingreifen, um die Matrix zu initialisieren, zu regulieren oder eine Beschränkung auf sie anzuwenden.

- Der Bias-Vektor: Dies sind die zusätzlichen Datensätze, die keine Eingabe erfordern und die der Ausgabeschicht entsprechen. Als solcher wird er auf 0 gesetzt. Auch hier können mehrere Parameter (Initialisierung, Beschränkung und Regularisierung) eine Rolle spielen.

Was du dir merken solltest

- In einem dichten neuronalen Netzwerk werden die Ergebnisse der vorherigen Schichten an die dichte Schicht weitergegeben. Es besteht also eine Hyperverbindung zwischen den verschiedenen Schichten, aus denen sich die Architektur des Lernmodells zusammensetzt.

- Um dieses Lernmodell zu implementieren, stehen mehrere Werkzeuge zur Verfügung. Dies gilt insbesondere für Keras, das eine vollständige Syntax bereitstellt. Dies erleichtert die Arbeit der Data Scientists.

- Um das Design eines dichten neuronalen Netzes zu beherrschen, ist es jedoch ratsam, sich in Datenwissenschaft ausbilden zu lassen. Erfahre mehr über unsere Schulungen.