Dans sa continuité de créations d’outils IA open source, Meta dévoile son nouveau générateur de code intelligent, Code Llama. Disponibles pour tous, plusieurs versions du modèle existent, dont une pour Python.

Un générateur de code intelligent ?

Basé sur son grand modèle de langage Llama 2. Ce nouvel outil, spécialement conçu pour la programmation et les développeurs, permet la génération de code et la production en langage naturel, en réponse à des prompts en code ou en langage naturel. Gratuit pour la recherche et l’usage commercial, Code Llama est disponible en trois versions :

- Code Llama : le modèle de base pour la génération de code

- Code Llama Python : spécialement conçu pour le langage de programmation Python

- Code Llama Instruct : affiné pour comprendre et générer des réponses en langage naturel à partir d’instructions.

La flexibilité de Code Llama le rend adaptable à plusieurs langages de programmation, dont les plus utilisés : Python, C++, Java, PHP, C# ou encore Bash.

En plus des versions, Meta propose trois tailles de Code Llama avec respectivement 7, 13 et 34 milliards de paramètres. Chacun de ces modèles est entraîné avec 500 milliards de jetons et de données liées à la programmation.

Mais alors qu’est-ce qui les distingue ? Les trois modèles répondent à des exigences différentes en matière de service et de temps de latence. Le modèle 7B, par exemple, peut être servi sur un seul GPU. Le modèle 34B donne les meilleurs résultats et permet une meilleure assistance au codage, mais les modèles 7B et 13B sont plus petits et donc plus rapides et mieux adaptés aux tâches nécessitant une faible latence, comme la complétion de code en temps réel.

Aussi, les modèles de base et d’instruction 7B et 13B ont également été entraînés avec la capacité FIM (fill-in-the-middle), ce qui leur permet d’insérer du code dans le code existant.

Meilleur que ses concurrents ?

Contrairement à GitHub Copilot d’OpenAI et le Ghostwriter de Google, Code Llama se révèle être un modèle de langage polyvalent, capable de générer du code complet, compléter des parties de code et aider à déboguer des programmes. Les capacités de rédaction en langage naturel facilitent l’apprentissage pour les débutants, mais les développeurs plus expérimentés y trouveront également des suggestions pertinentes et une assistance pour rédiger un code plus robuste et mieux documenté.

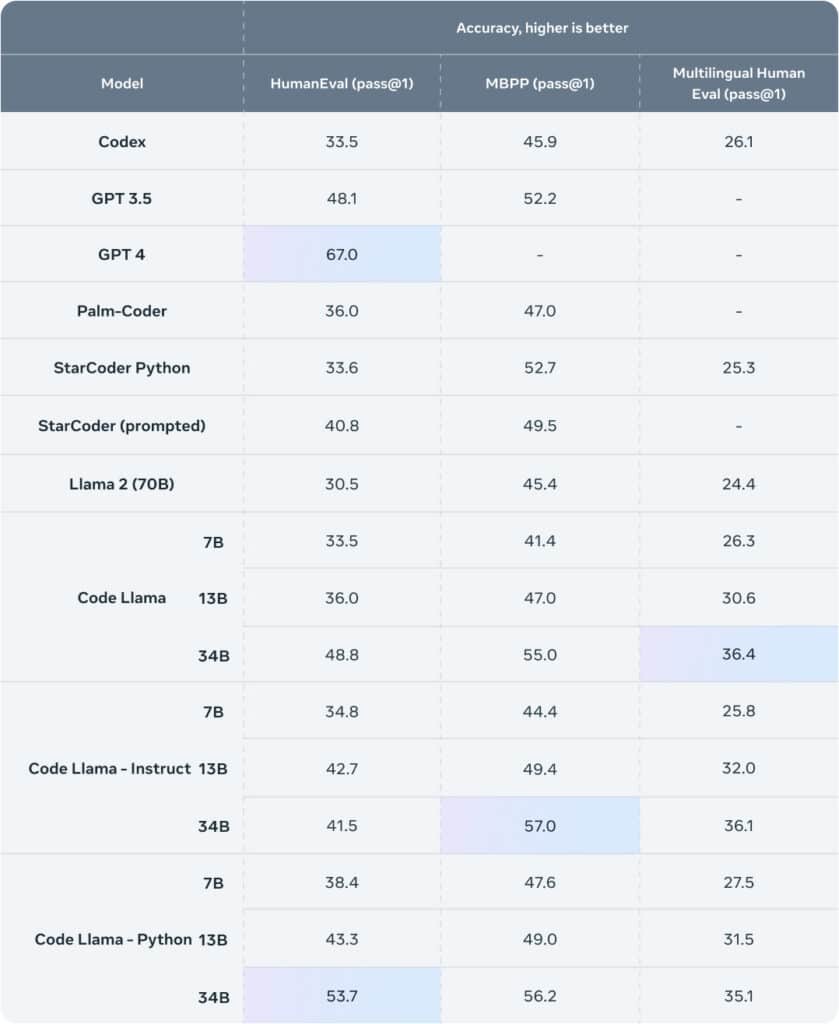

Par rapport aux autres solutions existantes, Meta a réalisé son propre benchmark pour tester Code Llama en utilisant HumanEval et MBPP (Mostly basic Python programming). Les résultats ont révélé que Code Llama a mieux performé que Llama 2 avec 53,7 % sur HumanEval et 56,2 % sur MBPP pour la version Python.

Si la course à l’innovation et à la concurrence ne s’arrête pas pour les grandes entreprises du numérique, elle peut se montrer très avantageuse pour les utilisateurs. Ne reste plus qu’à se former à ces nouveaux produits pour être à la pointe des dernières innovations. Si cet article vous a plu et que l’actualité data vous intéresse ou que vous envisagez une formation en Data Science, n’hésitez pas à découvrir nos articles ou nos offres de formations sur DataScientest.

Source : ai.meta.com