Après plusieurs mois de discrétion, la startup parisienne Mistral AI revient sur le devant de la scène avec le lancement de Mistral Small 3.1, un modèle d’intelligence artificielle open-source de 24 milliards de paramètres. Son objectif ? Proposer des performances supérieures aux modèles propriétaires de taille équivalente, tout en étant plus rapide et optimisé pour une exécution locale.

Un modèle léger et puissant

Doté d’une vitesse d’inférence de 150 tokens par seconde, Mistral Small 3.1 promet une efficacité d’exécution proche des modèles bien plus légers, avec une capacité de traitement multimodal et multilingue. Son architecture permet notamment une gestion avancée des contextes longs, acceptant des prompts allant jusqu’à 128 000 tokens.

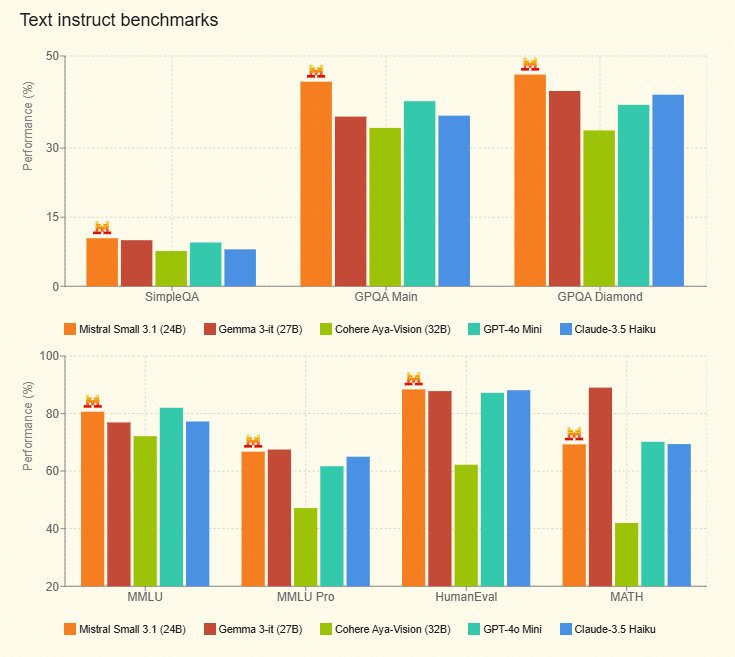

D’après les benchmarks internes de Mistral AI, ce modèle surpasse des concurrents directs comme Claude-3.5 Haiku et Gemma 3, avec un score de 81 % sur le MMLU, un indice de référence pour évaluer les capacités de raisonnement des LLMs. Ces résultats, bien que prometteurs, devront être confirmés par des tests indépendants.

Un atout pour l’exécution locale

Contrairement à de nombreux modèles nécessitant une infrastructure cloud, Mistral Small 3.1 peut être exécuté en local sur une machine équipée d’un GPU RTX 4090 ou d’un Mac doté de 32 Go de RAM. Cette approche vise les utilisateurs et entreprises souhaitant un contrôle total sur leurs données, en évitant de passer par des serveurs distants.

La startup met à disposition deux versions de son modèle sur Hugging Face :

- Mistral Small 3.1 Base, version brute du modèle

- Mistral Small 3.1 Instruct, optimisée pour l’interaction conversationnelle

Avec son positionnement open-source et orienté vers une exécution locale, Mistral Small 3.1 pourrait séduire de nombreux professionnels et chercheurs en quête d’alternatives aux solutions propriétaires d’OpenAI et Google. Reste à voir si les performances annoncées seront confirmées dans les mois à venir.

Si cet article vous a plu et si vous envisagez une carrière dans la Data Science ou tout simplement une montée en compétences dans votre domaine, n’hésitez pas à découvrir nos offres de formations ou nos articles de blog sur DataScientest.

Source : mistral.ai